假如有一天,你刷短视频、收到一条“熟人语音”请求转账,你是否会分辨真假?在这个人人都是“网络原住民”的时代,虚假内容的生成只需几秒,但识破骗局却并不容易。与此同时,网络内容安全治理早已不是“删帖”的简单应对,而是走向了系统化、智能化的新阶段。

近日,由上海交通大学蒋兴浩教授牵头完成的“复杂对抗场景下的网络媒体内容安全治理关键技术与应用”项目荣获2024年度上海市科技进步奖一等奖。项目从实战中来、回到应用中去,面对生成式AI时代下,海量舆情、对抗攻击与多源异构数据等挑战,他们用代码编织成防护网,用算法过滤掉网络世界的“毒刺”,构建起一套科学、精准、可扩展的技术体系,让“安全”真正落地。在上海交通大学计算机学院、网络空间安全学院、密码学院教授刘功申看来,“网络安全的核心,不止在于防御,更在于让技术有能力理解社会语境。”

一场“看不见的对抗”:

大模型时代如何“用AI识破AI”

网络内容安全,早已不只是防止“谣言”,更是一场日复一日的“动态博弈”。

“我们今天面对的内容安全挑战,远比十年前更加复杂。”刘功申所说的“复杂”,不仅体现在海量数据带来的计算压力,更在于信息背后的“对抗性”。“攻击者和防御者始终在互相学习、适应和升级技术,许多问题已经不能依靠人工判断或者静态规则去解决。”

在项目起步之初,团队就意识到,仅依赖关键词匹配与规则筛查的内容审核方式,已难以应对深度伪造等高级对抗模式。内容攻击常常潜藏于正常语义之中,或以图文、音视频等跨模态形式变体呈现,在社交平台上广泛传播,形成“表面无害、实则恶意”的信息污染。

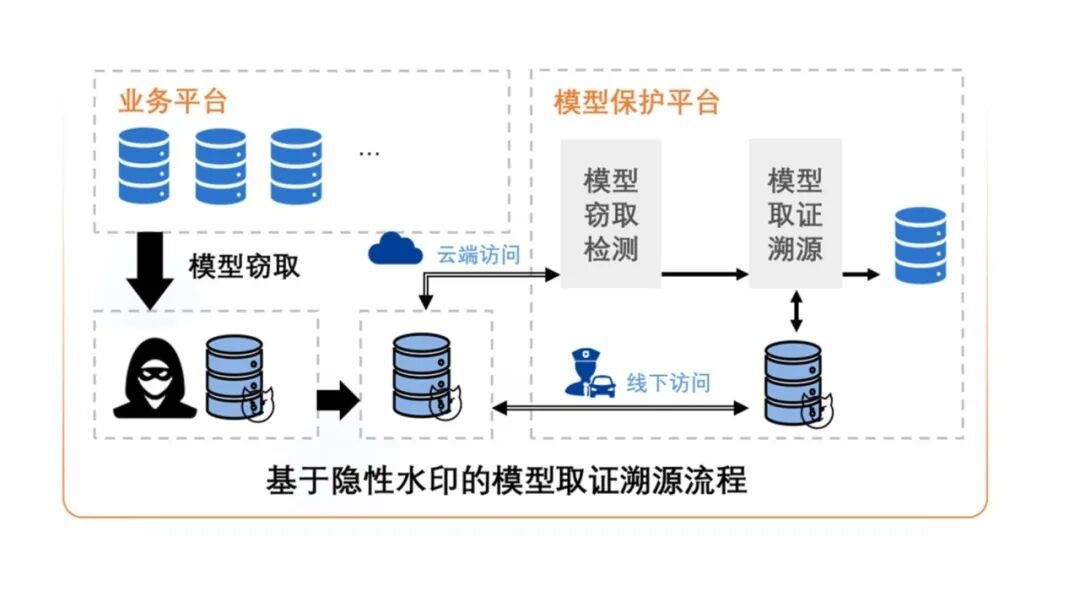

面对这些挑战,项目团队选择“用AI识破AI”。上海交通大学联合蚂蚁集团等多家单位,研发了一套“AI盾牌”系统,集检测、训练、溯源、干预于一体,构建起全流程智能防线。“这个系统就像给网络世界安装了‘X光安检机+AI侦探+应急响应小组’的组合装备。”刘功申介绍道,这一系统可同时分析文本、图像、音频和视频等多模态特征,实现对诱导性话术、违规图像、异常语音和AI换脸痕迹的精准识别,甚至能捕捉人眼难察的光影错位与细微呼吸节奏差异。

团队还搭建了“AI攻防训练场”,通过两个AI系统持续博弈,模拟并应对各种新型攻击方式,实现模型的快速自我进化与更新。此外,系统为每段AI生成内容植入“数字指纹”,即便信息被篡改或剪辑,亦可追溯其原始出处,广泛应用于AIGC论文检测等场景。在此基础上,系统还具备内容干预功能,能主动识别高风险传播倾向并以科普视频、虚拟人提示等方式进行柔性引导,为网络空间增添一层更有温度的认知防护。

“我们强化了模型的泛化能力,让它能在见到极少的新型样本时,也能给出高置信度的判断。”刘功申表示,这意味着不仅能识别已知样本,还能主动预测潜在的伪装方式。

在实战中生根:

让治理能力真正“落地生根”

复杂场景下的内容安全问题,不只在于实验室里的技术突破,更在于落地应用的能力。项目团队将项目的重点延伸到应用部署上,让前沿技术在真实业务环境中生根发芽。

“很多前沿模型在实验室效果不错,但一到真实平台就水土不服。”刘功申坦言。因此,团队从项目立项之初就与多家国家级平台、行业龙头企业和监管机构建立了深度合作机制,将研究部署在海量实时数据与实际业务需求上进行迭代打磨。据介绍,本项目的核心技术已经应用到了日常生活中。比如,支付宝的财富社区、直播、短视频等业务,都使用了这些技术来保障内容安全。

“AI不是为了取代人类,而是为了和人类协作。”刘功申强调,系统可以做初步筛选,把明显违规的内容过滤掉,把边界模糊的交给人工复审,大大减轻了人工审核负担。这项技术不仅管控,也服务。团队还研发了AI内容标注系统,为平台提供“内容可信度评分”和“内容风险提示”,帮助创作者优化视频质量,避免无意违规。“我们不希望这套系统只是一个‘删帖机器’。它更像是导航仪,让创作者和平台都能更安心地‘开车’。”

“上海市科技进步奖对于我们是莫大的鼓励,但更重要的是它提醒我们,科学研究必须回应时代需求。网络安全本质上是一个共同体问题,我们希望用可解释、可信赖、可持续的方式,来帮助这个共同体建立起一套适应未来挑战的能力。”

在这个每秒都有AI生成内容诞生的时代,网络安全早已不是简单的技术问题,而是关乎每个人数字生存质量的重要议题。“未来最理想的状态,是我们不再需要‘治理’,AI本身就能自我规范。”刘功申相信,那个愿景也许还在远方,但今天的每一步努力,都是在向它靠近。

企业及专家观点不代表官方立场

作者:许织

资料提供:刘功申

↓分享

↓点赞

↓在看